Twitter 'zarar vermesi muhtemel' deepfake videoları tamamen yasaklıyor

Twitter, ABD Başkanlık seçimleri öncesinde sahte içeriklerle ilgili denetimlerini sıkılaştırıyor.

Şirket, yapay ve manipüle edilmiş videolarla ilgili yeni kurallarını paylaştı.

5 Mart itibariyle hayata geçen bu sistem, deepfake videoların platformdaki varlığını sonlandırmaya odaklanıyor.

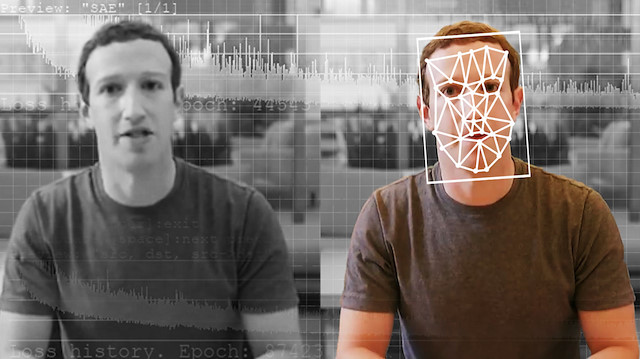

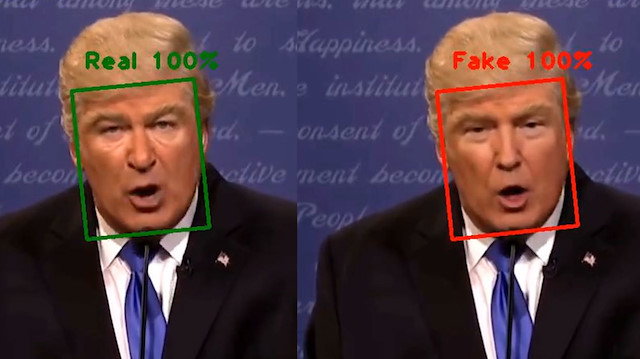

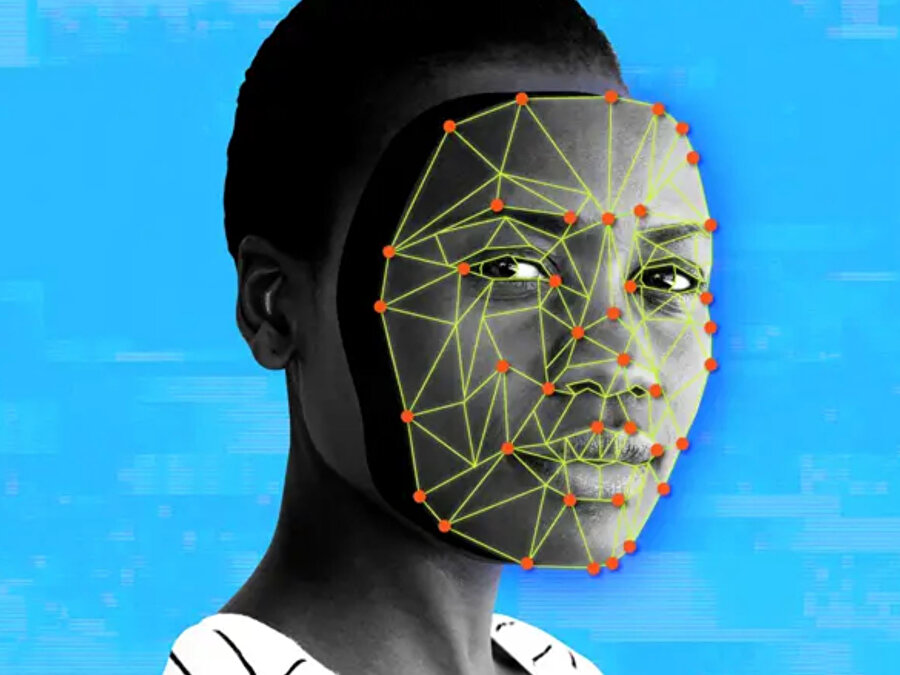

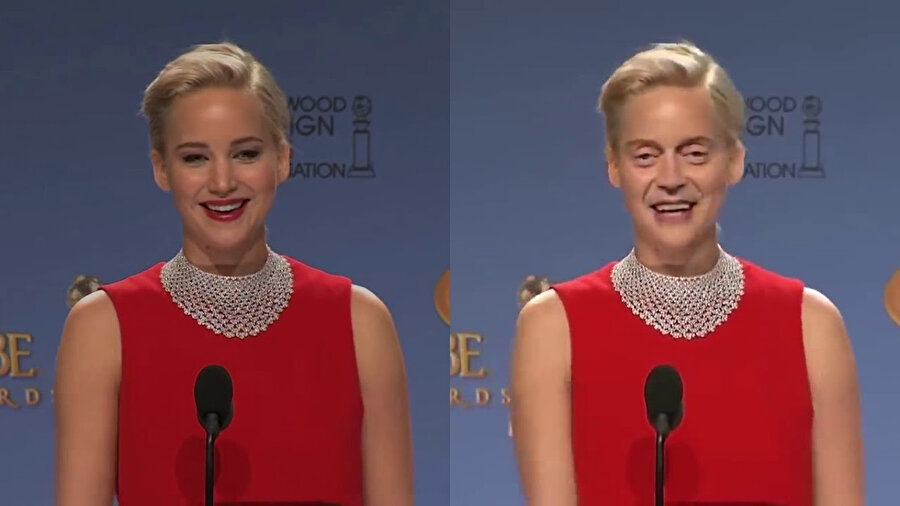

Twitter, yapay ve manipüle edilmiş videolarla ilgili yeni kurallarını yayınladı. Şirket, artık 'zarar verme olasılığı' olan deepfake içerikleri ince eleyip sık dokuyacağını belirtiyor. Sosyal ağda insanların neyin gerçek neyin sahte olduğunu anlamalarına yardımcı olmak için tweet'ler 'deepfake' olarak etiketlenecek.

5 Mart'tan itibaren hayata geçiyor

Medyaların aldatıcı şekilde değiştirip değiştirilmediği belirlenirken Twitter aslında birçokfaktörü göz önüne alacağını belirtiyor. Aynı zamanda oluşturulan sahte videonun kamu güvenliğini etkileyip etkilemeyeceği ya da ciddi zarar verme olasılığı da araştırılacak.

Şirket, 5 Mart'tan itibaren, tweet'leri 'aldatıcı şekilde değiştirilmiş içerik' olarak etiketleyebilir. Ayrıca, tweet'lerin görünürlüğünü azaltıp önerilmesini engellemek için de çalışmalar yapacak.

Bu değişiklikler aslında deepfake ile mücadelenin sonucu. Geçen yıl vadettiği kuralları bu sene aktif eden platform, aslında tüm bunları kullanıcıların geri bildirimlerine dayanarak hazırladığını da özellikle belirtiyor.

Asıl amaç, ABD Başkanlık seçimi yaklaştıkça yayılabilecek siyasi deepfake videoları önlemek. Yani aslına bakarsanız Twitter, yanlış bilgilendirme kampanyalarına ortak olmak istemiyor.

We know that some Tweets include manipulated photos or videos that can cause people harm. Today we’re introducing a new rule and a label that will address this and give people more context around these Tweets pic.twitter.com/P1ThCsirZ4

— Twitter Safety (@TwitterSafety) February 4, 2020